日本のSNS規制はどうあるべきか?

日本では、現時点で青少年のSNS利用を一律に法で禁止する方向ではなく、事業者による保護機能の強化、保護者による見守り、情報モラル教育をどう組み合わせるかが主な論点となっています。

SNS規制を考える3つのポイント

子どものSNS利用を考える際は、単に「禁止するか、しないか」ではなく、次の3点を分けて整理することが大切です。

① 被害への対応をどう早めるか

SNS上では、誹謗中傷や権利侵害にあたる投稿が短時間で拡散することがあります。被害者が相談しやすい窓口、削除申出への分かりやすい対応、運用の透明性は、子どもを守る観点からも重要です。

② 子どもの安全と成長の両方をどう支えるか

子どもを守るためには、危険な接触や過度な利用を防ぐ仕組みが必要です。一方で、SNSは友人との連絡、情報収集、自己表現の場にもなっています。安全確保と、学びや社会参加の機会の両立が課題です。

③ 家庭・学校・事業者がどう役割分担するか

現実には、法律だけで全てを解決することはできません。事業者の保護機能、保護者の見守り、学校での情報モラル教育を組み合わせていくことが、実務上は重要です。

一律に厳しく規制するだけでは解決しにくい理由

1. 隠れ利用や別サービスへの移動

年齢だけで一律に禁止しても、年齢を偽った登録や、より管理の届きにくいサービスへの移動が起こるおそれがあります。表向きの利用を減らしても、危険が見えにくくなることには注意が必要です。

2. 家庭ごとの事情は大きく異なる

SNSの使い方は、子どもの年齢や性格、家庭の方針、通学や習い事の連絡事情などによって大きく異なります。全ての家庭に同じルールを当てはめるだけでは、かえって実情に合わない場合があります。

3. 必要なのは「使わせない」だけでなく「使い方を学ぶ」こと

子どもたちは、将来にわたってデジタル機器やネットサービスと関わっていきます。トラブルを避けるためにも、使い方のルール、困ったときの相談、情報の見分け方を家庭や学校で学ぶことが欠かせません。

4. 表現の自由や知る機会とのバランス

インターネット上の情報には危険もありますが、学習や防災、地域情報、進路に関する情報など、役立つ情報も少なくありません。安全を守ることと、必要な情報に触れる機会を確保することの両立が求められます。

日本における青少年のSNS対策の現在地

一律禁止ではなく、被害対応・保護機能・見守りを組み合わせる方向

日本では、青少年のネット利用について、フィルタリングや保護者の見守りを基本としつつ、事業者の安全対策を強めていく考え方が中心です。

1. 情プラ法による被害対応の強化

2025年4月に施行された情報流通プラットフォーム対処法では、大規模なプラットフォーム事業者に対し、削除申出の窓口整備、対応体制の整備、削除基準や運用状況の公表などが求められるようになりました。

これは、誹謗中傷や権利侵害の被害に対して、事業者がより迅速かつわかりやすく対応することを目的とするものです。

2. 青少年インターネット環境整備法の考え方

青少年インターネット環境整備法では、18歳未満の青少年が安全にネットを利用できるよう、事業者によるフィルタリング提供と、保護者による適切な管理が基本的な考え方とされています。

つまり、現行制度の軸は「年齢で一律に閉め出すこと」よりも、有害情報への接触を減らしながら、必要な利用を支えることにあります。

3. 事業者側の保護機能の拡充

近年は、SNS各社が10代の利用者向けに、非公開設定、DM制限、夜間通知の抑制、利用時間の見直しを促す機能などを強化しています。

こうした機能は、法律だけに頼らず、設計そのものを安全側に寄せる工夫として注目されています。

| 13歳以上 | 10代向けの保護機能として、非公開設定やメッセージ制限などを強化する「ティーンアカウント」を順次導入。 保護者向け情報 ≫ |

|

| TikTok | 13歳以上 | 13〜15歳のアカウントでは非公開設定や利用時間管理など、年齢に応じた安全設定が用意されています。 保護者向けガイド ≫ |

| X | 13歳以上 | 保護者および未成年者向けに、安全性とプライバシーに関する案内があります。 保護者および未成年者向け情報 ≫ |

| YouTube | 年齢に応じた利用 | 13歳未満の子ども向けにはYouTube Kidsや保護者の管理下での利用方法が案内されています。 YouTube Kids ≫ |

| LINE | 機能ごとの制限あり | 18歳未満や年齢未確認の利用者について、一部機能に制限が設けられています。 保護者・教育関係者の皆さんへ ≫ |

4. 今後の焦点

今後の焦点は、実効性のある年齢確認、依存を招きやすい設計への対応、性的被害や自傷関連情報への対策などです。

一律禁止へ直ちに進むというより、保護機能と運用の実効性をどう高めるかが、引き続き重要なテーマになっています。

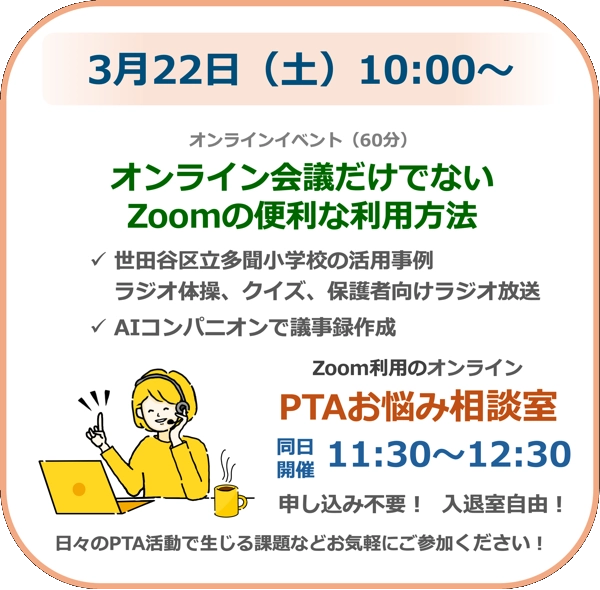

保護者・PTAとしてできること

禁止だけに頼らず、機能・ルール・対話を組み合わせる

子どものSNS利用に対して、家庭やPTAができることは少なくありません。大切なのは、「使わせない」だけで終わらせず、実際の使い方を整えることです。

1. 最初に確認したい4つの設定

- アカウント公開範囲(公開・非公開)

- DMや通話を受けられる相手の範囲

- 利用時間や夜間通知の設定

- フィルタリングや保護者管理機能の有効化

2. 家庭で話し合いたいルール

ルールは、ただ禁止事項を並べるだけでは長続きしません。利用時間、投稿してよい内容、知らない人とのやり取り、困ったときの相談先を親子で確認しておくことが大切です。

利用時間

平日と休日で使い方を分ける、就寝前は使わないなど、生活リズムに合わせたルールを決める。投稿内容

顔写真、制服、学校名、位置情報、友人の写真など、出してよい情報と控えたい情報を確認する。連絡相手

知らない人からのDMや勧誘、別アプリへの誘導があったときは、返信前に相談する約束をする。トラブル時の対応

嫌な投稿を見た、拡散された、脅されたなどの時は、1人で抱えず、保護者や学校にすぐ相談する。3. PTAや学校で共有したいこと

家庭だけで抱え込まず、学校やPTAでも、ネットいじめ、誹謗中傷、闇バイト勧誘、性被害、偽情報に関する基本的な注意点を共有しておくことが望まれます。

また、トラブルが起きた後だけでなく、入学時や新年度の説明機会に、保護者向けの確認事項として案内することも有効です。

4. 大人側も学び続ける

子どもにルールを求める以上、保護者やPTA役員も、サービスの特徴や設定方法を知っておく必要があります。最新機能の確認と、子どもとの対話を続けることが、最も現実的な対策の一つです。

政治情報や社会的な話題への向き合い方

偽情報に振り回されず、出所を確認する習慣を

SNSでは、選挙、災害、事件、教育政策など、社会的な話題に関する情報が急速に広がります。子どもだけでなく大人にとっても、真偽が不確かな情報、感情を強くあおる投稿、切り取り動画には注意が必要です。

1. まず出所を確認する

投稿だけで判断せず、元になっている発言や記事、公的機関の発表があるかを確認する習慣が大切です。

2. 強い言葉ほど一呼吸置く

「絶対に危険」「完全に間違い」「すぐ拡散して」など、感情を動かす強い表現ほど、誤情報やミスリードが混ざることがあります。

3. 家庭で話し合う機会にする

社会的なニュースが話題になったときは、親子で「どこから出た情報か」「なぜ広がったのか」を確認する機会にできます。SNSを単なる危険物として避けるのではなく、情報の見分け方を学ぶ場にすることも大切です。

あわせて読みたい